Jude Klevine - Actuaire Associé

Jude Klevine - Actuaire Associé

Actuaire associé à l’Institut des actuaires de France, je travaille actuellement chez Cardif Lux Vie, compagnie d’assurance basée au Luxembourg.

Mon Parcours Scolaire

2019

Admission en double licence Mathématiques et Informatique à l’Université Clermont Auvergne (2019-2021). Cette formation de deux ans m’a permis d’acquérir de solides bases en programmation, tout en approfondissant mes connaissances en mathématiques, discipline qui m’a toujours passionné.

2021

Admission au DUAS (Diplôme Universitaire d’Actuaire de Strasbourg) pour une formation de 3 ans (2021–2024). J'ai été admis sur dossier. Cette formation m’a permis d’en apprendre davantage sur le métier avant de l’exercer pleinement. Formation validée à la suite de la soutenance d’un mémoire.

2025

Soutenance devant l’Institut des Actuaires validée pour l’obtention du titre d’actuaire. Mémoire : « Analyse et application d’une méthode de provisionnement sans triangle en assurance santé », axé sur une approche innovante en santé hors cadre classique.

Je m’appelle Jude Klevine. Passionné par les mathématiques, l’économie, la finance et la programmation, je me suis naturellement orienté vers l’actuariat afin de mettre en pratique toutes mes compétences dans ce domaine. Certaines notions actuarielles, comme le calcul des provisions ou les mécanismes de réassurance, peuvent sembler complexes et décourageantes pour les étudiants et tous ceux qui souhaitent découvrir ce métier. Cette page a pour but de démystifier ces concepts et de les rendre accessibles à tous, pour que chacun puisse comprendre et s’approprier l’essentiel de l’actuariat.

Mes Compétences en Chiffres

R & Python

SQL

Visualisation

Mes Compétences

Conception & Analyse Statistique

Expertise dans la création et l’analyse d’enquêtes (ex. aéroport d’Orly) avec LimeSurvey et RStudio pour des insights précis et exploitables.

Programmation

Maîtrise de R et Python pour traiter, analyser et visualiser des données avec une approche performante et efficace.

Gestion de Bases de Données

Compétences en FME (ETL), SQL et PostgreSQL pour structurer, interroger et optimiser des bases de données relationnelles.

Visualisation de Données

Création de graphiques clairs et interactifs avec ggplot2, Shiny, et Power BI pour une communication efficace des données.

Conception et Analyse d’Enquêtes Statistiques : Lors de la refonte de l’aéroport d’Orly, j’ai conçu des questionnaires percutants avec LimeSurvey, collecté des données fiables, et analysé celles-ci avec RStudio pour des conclusions actionnables.

Programmation : Je maîtrise R et Python pour nettoyer des datasets, automatiser des tâches, et développer des scripts complexes avec une approche optimisée.

Gestion de Bases de Données : Avec SQL et FME (ETL), je structure et interroge des bases comme PostgreSQL, optimisant les requêtes pour une gestion efficace des données.

Visualisation de Données : J’utilise ggplot2, Shiny, et Power BI pour transformer des données brutes en visualisations claires, facilitant la prise de décision.

Recherche et Présentation : Sur le projet Rennes, j’ai exploré le patrimoine via des archives et analysé des données INSEE (population, natalité, PIB) avec RStudio, produisant des courbes dynamiques et un rapport en anglais avec des recommandations écologiques.

Gestion et Analyse de Données Complexes : Le projet sur les données gouvernementales m’a permis de développer une application Shiny pour visualiser des données gouvernementales via des tableaux et graphiques interactifs.

Analyse Statistique et Reporting : Sur les Solvabilité 2, j’ai utilisé Power BI pour des analyses descriptives et RMarkdown pour des rapports automatisés, intégrant des graphiques et des recommandations stratégiques.

Synthèse et Visualisation : Le projet Bordeaux-Lille a impliqué le nettoyage de données DVF avec Excel, des analyses statistiques avec R, et des visualisations (barres, cartes) pour guider les investisseurs et décideurs.

Mes Compétences : En tant que étudiants en science des données , ma capacité à concevoir et à analyser des enquêtes statistiques est essentielle pour recueillir des données significatives. Cela implique la conception de questions pertinentes, la mise en place de méthodes de collecte de données et l'utilisation d'outils statistiques pour interpréter les résultats. Ma compétence dans la conception de questionnaires représente un en,jeu cruciale. Élaborer des questions claires et concises est essentiel pour recueillir des informations précises et exploitables tout en évitant toute confusion pour les répondants. L'utilisation de RStudio pour manipuler des bases de données, créer des représentations graphiques et effectuer des analyses statistiques a été nécessaire, démontrant ainsi la nécessité de compétences en programmation pour exploiter pleinement ces outils. Mes compétences en recherche documentaire ont été mises à contribution, comme en témoigne la référence à des ressources externes, telles que des sites Web, pour mieux comprendre l'aéroport d'Orly. Cela souligne l'importance des compétences en recherche documentaire pour collecter des informations contextuelles pertinentes. La gestion de projet a été un aspect crucial de mon travail, assurant la planification, l'organisation et la réalisation du projet dans les délais impartis. Ma capacité à communiquer efficacement a été mise en œuvre lors de la rédaction claire et concise du rapport. Il était essentiel de transmettre de manière compréhensible les résultats de l'enquête, les analyses statistiques et les recommandations. La collecte, le stockage et le traitement des données ont exigé des compétences en gestion de données, incluant l'utilisation d'outils tels qu'Excel pour le stockage et la manipulation des données. En matière d'éthique de la recherche, garantir la confidentialité des répondants et respecter les normes éthiques dans la collecte et le traitement des données ont été des compétences essentielles pour assurer la validité et l'intégrité du projet. En combinant ces compétences, j'ai pu mener une enquête approfondie, analyser les données recueillies et formuler des recommandations significatives pour améliorer l'expérience client à l'aéroport d'Orly dans le cadre de sa refonte.

Les Cours

Etude d'un pret gigogne

- Objectif : Etudier le montant de remboursement d'une pret Développer des outils interactifs pour gérer les données géographiques.

- Contexte : Stage au SIG du Grand Avignon (avril-juillet 2025).

- Projet

- Résultats : Outils interactifs pour la planification urbaine, présentés aux 16 communes.

- Outils : Principalement du Excel, mais possibile de le faire en R ou en Python.

Ce stage m’a permis de développer des applications interactives pour le Grand Avignon, en utilisant QGIS et SQL pour gérer des données géographiques. Présenter mes résultats aux communes m’a appris à communiquer efficacement avec des décideurs.

Provisionnement non vie

- Objectif : Explorer les relations entre variables socio-économiques.

- Cours : 📁

- Visualisation : Biplots et scree plots avec `ggplot2`.

- Résultats : Identification de corrélations significatives.

- Outils : https://rpubs.com/JKLEVINE/Chain_Ladder

- Outils : https://rpubs.com/JKLEVINE/Separation_de_taylor

J’ai utilisé R et SAS pour analyser des données complexes, produisant des visualisations claires et un rapport structuré en LaTeX, renforçant mes compétences en statistique avancée.

Modelisation actuarielle

- Objectif : Identifier les points faibles de l’expérience client à l’aéroport d’Orly pour proposer des améliorations concrètes.

- Méthodologie : Création d’un questionnaire Google Forms avec des questions sur le confort, la mobilité et la courtoisie du personnel.

- Collecte de données : Distribution auprès d’un échantillon de voyageurs (100 réponses collectées).

- Exemple : des réponses (suppression des valeurs manquantes), et calculs statistiques (moyennes, écarts-types).

- Visualisation : Génération de graphiques comme des histogrammes pour les temps d’attente et des diagrammes en barres pour la satisfaction.

- Résultats : Mise en évidence de temps d’attente excessifs (moyenne de 25 min) et d’un manque de signalisation claire (60 % des répondants).

- Recommandations : Formation du personnel à la gestion des flux, ajout de panneaux informatifs, et investissement dans des bornes numériques.

- Outils utilisés : LimeSurvey, RStudio (packages `dplyr`, `ggplot2`), Excel pour prétraitement.

Provisionnement non vie

- Objectif ssss: Produire un rapport en anglais sur le patrimoine culturel, historique et socio-économique de Rennes.

- Cours : Consultation d’archives municipales, d’études historiques et de publications académiques. 📁 Archives municipales de Strasbourg

- Données collectées : Statistiques INSEE sur la démographie (population, âge moyen), l’économie (PIB, emploi) et l’éducation.

- Analyse : Traitement des données dans RStudio pour calculer des indicateurs comme la croissance démographique (+2 %/an).

- Visualisation : Création de courbes temporelles, Pie plots et Bar plots.

- Rapport : Rédaction en anglais avec introduction, méthodologie, résultats et recommandations (ex. transports écologiques).

- Collaboration : Travail en équipe pour intégrer les feedbacks et finaliser le document.

- Outils utilisés : RStudio (`tidyr`, `ggplot2`), INSEE, Word pour la mise en page.

Ce projet m’a plongé dans une exploration fascinante de Rennes, une ville que je ne connaissais pas bien au départ. Fouiller dans les archives m’a donné une appréciation pour le contexte historique, tandis que les données INSEE m’ont offert une vue quantitative précise. Les visualisations dans RStudio – comme une courbe montrant une croissance démographique stable – ont été un défi technique, car il fallait gérer des données sur plusieurs décennies. Rédiger en anglais m’a poussé à structurer mes idées clairement pour un public international, et les recommandations (ex. tramways écologiques) ont nécessité une réflexion sur l’impact à long terme. Ce travail m’a appris à combiner rigueur scientifique et communication efficace.

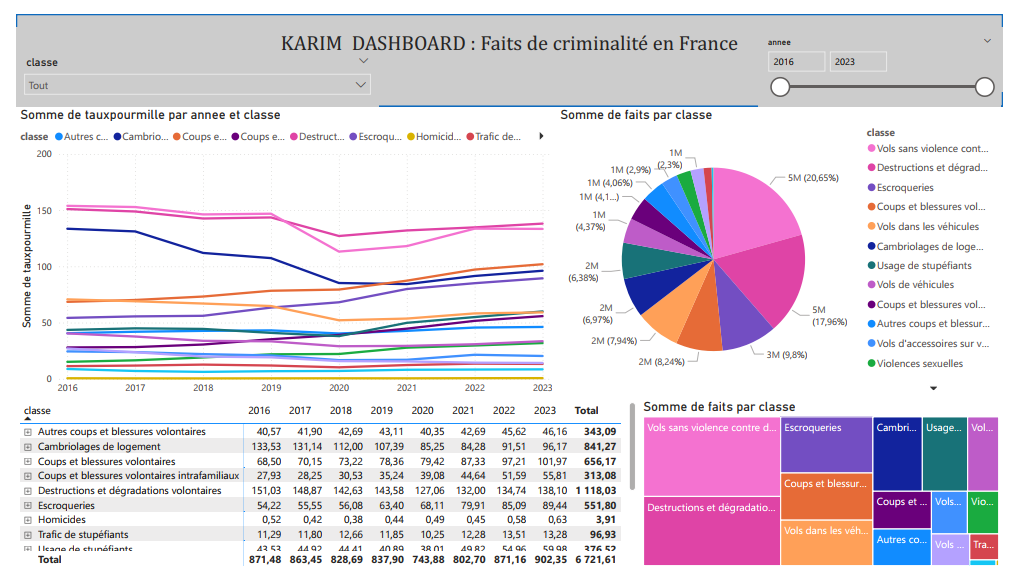

Données Gouvernementales

- Objectif : Développer une interface interactive pour explorer des données gouvernementales à partir d’un fichier CSV.

- Préparation : Importation de `oc_accounts.csv` et préparation des données pour une analyse interactive.

- Structure : Données structurées avec une colonne `user` (texte) contenant des identifiants, enrichies par des métadonnées.

- Programmation : Utilisation de R et de Shiny pour créer une application interactive.

- Visualisation : Graphiques interactifs développés avec Shiny et `ggplot2`.

- Résultats : Interface déployée sur shinyapps.io, offrant une exploration intuitive pour des utilisateurs non techniques.

- Outils utilisés : R (`shiny`, `ggplot2`).

Ce projet m’a révélé la puissance des interfaces interactives pour rendre les données accessibles. Après avoir récemment appris à utiliser Shiny, j’ai créé une application qui transforme un fichier CSV brut en visualisations dynamiques, comme des graphiques filtrables par domaine email. Ce processus m’a permis de renforcer mes compétences en R et de découvrir l’importance de penser à l’expérience utilisateur, une compétence essentielle pour les projets de data science appliquée.

Solvabilité 2

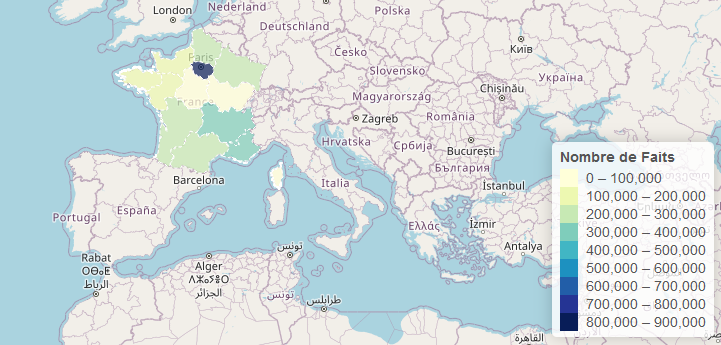

- Objectif : Étudier les corrélations entre criminalité, logement et démographie.

- Données : Extraction de statistiques sur les crimes et population.

- Structure : Création d’un schéma relationnel en SQL avec tables liées (crimes, logements).

- Visualisation : Séries temporelles , diagrammes en boîte (variations régionales).

- Rapport : Génération automatisée avec RMarkdown, incluant graphiques et interprétations.

- Outils utilisés :Power BI.

Analyser les Solvabilité 2 m’a plongé dans des données sociales riches et complexes. Ce projet m’a appris à contextualiser les données dans un cadre socio-économique et à produire des rapports qui parlent aux décideurs, une compétence que je veux approfondir.

Tarification des produits d'assurance

- Objectif : Tarification d'un produit cyber risque.

- Données : Collecte d’un dataset sur les voitures d’occasion (marque, modèle, puissance, prix) via des sites comme Leboncoin.

- Préparation : Nettoyage dans Excel (suppression des doublons, normalisation des unités).

- Analyse : Régressions dans R pour évaluer l’impact de la puissance sur le prix, corrélations entre variables.

- Visualisation : Nuages de points (puissance vs prix), diagrammes en barres (prix moyen par tranche de puissance).

- Résultats : Forte corrélation positive (r=0.85) entre puissance et prix, avec des exceptions pour les modèles économiques.

- Recommandations : Conseils pour les acheteurs (ex. privilégier des modèles de 100-150 ch pour un bon rapport qualité-prix).

- Outils utilisés : Excel, HTML, CSS, JS.

Ce projet m’a passionné car il touchait à mon intérêt pour l’automobile. Collecter des données sur des sites comme Leboncoin m’a demandé de trier des annonces souvent incomplètes, un défi de patience. L’analyse dans R m’a révélé une logique limpide : plus de chevaux, plus de coûts, mais des marques comme Dacia défiaient cette règle. Les nuages de points ont été fascinants à créer – chaque point racontait l’histoire d’une voiture. Publier sur RPubs m’a appris à rendre mes analyses accessibles au public, une étape qui m’a motivé à peaufiner mes compétences en visualisation.

Projets mathématiques

1) Valoriser

A. Mise en Œuvre d’une Enquête

- Objectif : Évaluer la satisfaction des services universitaires.

- Méthodologie : Questionnaire LimeSurvey, analyse dans RStudio.

- Résultat : Taux de satisfaction de 75 %.

- Outils : LimeSurvey, RStudio.

J’ai conçu une enquête pour évaluer les services universitaires, apprenant à poser des questions sans biais et à analyser les résultats pour identifier des améliorations.

B. Présentation en Anglais d’un Territoire

- Objectif : Analyser Avignon en anglais.

- Méthodologie : Recherche INSEE, visualisations dans R.

- Résultat : Rapport sur le tourisme durable.

- Outils : RStudio, INSEE, PowerPoint.

J’ai étudié Avignon, produisant un rapport en anglais avec des visualisations sur le tourisme, renforçant mes compétences linguistiques et analytiques.

2) Traiter des Données Structurées

A. Écriture et Lecture de Données

- Objectif : Manipuler des données dans PostgreSQL.

- Méthodologie : Création d’une table, requêtes SQL.

- Résultat : Extraction efficace des données.

- Outils : PostgreSQL, pgAdmin.

J’ai appris à structurer des bases de données et à écrire des requêtes SQL, posant les bases pour des projets complexes.

B. Analyse et Visualisation

- Objectif : Produire un rapport visuel sur des ventes.

- Méthodologie : Analyse dans R, rapport RMarkdown.

- Résultat : Rapport avec graphiques (ex. pic des ventes).

- Outils : R, RMarkdown.

J’ai transformé des données de ventes en rapports visuels, apprenant à automatiser avec RMarkdown.

3) Analyser des Données Descriptives

A. Estimation par Échantillonnage

- Objectif : Estimer des revenus via un échantillon.

- Méthodologie : Calculs dans R, intervalles de confiance.

- Résultat : Estimation précise (±5 %).

- Outils : R.

J’ai appris à extrapoler des données avec des échantillons, en validant la fiabilité via des histogrammes.

B. Synthèse de Données

- Objectif : Résumer des données brutes.

- Méthodologie : Nettoyage Excel, tableaux R.

- Résultat : Tableau synthétique clair.

- Outils : Excel, R.

J’ai nettoyé et synthétisé des données, rendant des informations complexes accessibles.

4) Stage au sein du Système d'Information Géographique du Grand Avignon

A. Compétence Traiter

- Objectif : Unifier et automatiser le traitement des données multidimensionnelles ADS.

- Méthodologie : Création d’une table unifiée « synthese dossier » via requêtes SQL complexes (

LEFT JOIN,DISTINCT, filtrages, transformations, intersections spatiales, centroïdes). - Résultat : Un entrepôt de données efficace et actualisé automatiquement.

- Outils : pgAdmin, SQL, FME Workbench (

AttributeManager,FeatureJoiner).

J’ai automatisé la consolidation et la mise à jour de données issues de multiples sources en utilisant FME, améliorant significativement la performance des requêtes SQL initiales grâce à une optimisation ciblée des jointures lentes.

B. Compétence Analyser

- Objectif : Détecter des tendances dans les données ADS.

- Méthodologie : Analyse exploratoire avec QGIS et GeoSoftware, ratios, corrélations.

- Résultat : Identification de phénomènes comme la montée des installations photovoltaïques ou les liens entre densité urbaine et DIA.

- Outils : QGIS, GeoSoftware.

J’ai mis en œuvre une analyse croisée des données par commune et par type de dossier, en calculant des ratios de répartition et en identifiant des corrélations significatives, tout en tenant compte des biais présents dans certaines sources (ex. : erreurs dans Oxalis).

C. Compétence Valoriser

- Objectif : Argumenter et restituer les résultats de l’analyse aux parties prenantes.

- Méthodologie : Conception d’un tableau de bord interactif avec 7 onglets, filtres dynamiques, et présentation aux élus locaux.

- Résultat : Prise de décision facilitée pour les 16 communes du Grand Avignon.

- Outils : GeoSoftware.

J’ai présenté les résultats de l’application en mettant en valeur les divergences d’évolution entre les déclarations préalables (DP) et les permis de construire (PC), en les interprétant au regard de la conjoncture (crise énergétique, taux d’intérêt, accès aux matériaux), tout en défendant mes choix méthodologiques face à un public hétérogène.

D. Compétence Développer

- Objectif : Intégrer l’application dans l’environnement de l’organisation.

- Méthodologie : Développement HTML/CSS pour l’interface et les sections interactives, documentation complète.

- Résultat : Application robuste, testée et conforme aux exigences réglementaires.

- Outils : HTML, CSS, SQL, FME.

J’ai conçu une interface intuitive intégrant des champs texte et des documents interactifs. J’ai veillé à la conformité légale, en particulier en restreignant l’accès aux données propriétaires, tout en garantissant une vision globale utile à la décision publique. Des tests rigoureux ont permis de fiabiliser l’ensemble de la solution.

E. Bilan

- Résultat : Mise en œuvre d’une solution décisionnelle opérationnelle à forte valeur ajoutée.

- Impact : Consolidation des compétences VCOD (Valoriser, Comprendre, Organiser, Développer).

- Outils : QGIS, GeoSoftware, SQL, FME, HTML/CSS.

Ce projet m’a permis d’appliquer concrètement mes compétences techniques et analytiques à une problématique territoriale réelle, tout en développant des capacités de restitution adaptées à un public de décideurs.

Mes Motivations

Curiosité Intellectuelle

Explorer les données pour découvrir des patterns cachés et répondre à des questions complexes est ce qui me pousse chaque jour.

Défis Techniques

J’aime résoudre des problèmes ardus, optimiser des algorithmes et transformer des données brutes en solutions concrètes.

Impact Réel

Utiliser la science des données pour améliorer des services, comme les transports ou l’accès à l’information, me motive profondément.

XX

Ce qui me fascine dans ce domaine, c’est son pouvoir de révélation. Les données, lorsqu’elles sont bien analysées, ne mentent pas : elles dévoilent des vérités cachées, des tendances insoupçonnées, des opportunités inédites. Prenez l’exemple d’une entreprise qui ne comprend pas pourquoi ses ventes chutent : une analyse bien menée peut révéler un changement dans le comportement des consommateurs, une faille dans la logistique, ou une campagne marketing mal ciblée. Cette capacité à éclairer les décisions me motive chaque jour à perfectionner mes compétences, que ce soit en codage, en statistique ou en visualisation.

Mais au-delà de la technique, je suis animé par une vision plus large : celle d’une science des données responsable et éthique. Dans un monde où les données personnelles sont omniprésentes, je crois qu’il est crucial de les utiliser avec respect et transparence. Les scandales autour de la vie privée, comme ceux liés à l’IA ou aux réseaux sociaux, m’ont sensibilisé à l’importance de mettre en place des pratiques éthiques. Mon objectif est de contribuer à des projets qui non seulement innovent, mais qui respectent aussi les individus derrière les chiffres – un équilibre délicat mais essentiel à mes yeux.

Mon parcours en BUT Science des Données à Avignon est la fondation sur laquelle je construis cette ambition. Chaque projet, chaque stage, chaque ligne de code m’apporte une brique supplémentaire pour bâtir une carrière qui ait du sens. Par exemple, travailler sur “Cordée de la réussite” m’a montré comment des idées créatives peuvent naître de contraintes strictes – concevoir un plat futuriste sans produits menacés d’extinction demandait une réflexion hors des sentiers battus. De même, mes stages chez Vinci m’ont appris à appliquer des outils analytiques à des problématiques industrielles, tandis que mes explorations personnelles en lecture ou en jeux vidéo nourrissent ma capacité à penser différemment.

À long terme, je rêve de participer à des projets qui transcendent les frontières – qu’il s’agisse d’analyser les impacts du changement climatique, d’optimiser les infrastructures urbaines ou de démocratiser l’accès à l’éducation grâce aux données. La science des données est un levier pour le progrès, et je veux être au cœur de cette transformation. Mon BUT n’est qu’un début : je compte poursuivre mes études, peut-être avec un master ou une spécialisation en IA, pour approfondir mes compétences et élargir mon champ d’action. Ce qui me pousse, c’est cette conviction que les données, bien utilisées, peuvent changer le monde – et je veux y contribuer, pas à pas, avec rigueur, créativité et humanité.

Cours et Travaux Dirigés

Analyse de Données

Découverte et manipulation de jeux de données réels, application de statistiques descriptives et de modèles prédictifs pour en tirer des conclusions pertinentes.

Programmation et Bases de Données

Utilisation de Python, SQL, R et d’outils comme Pandas ou Power BI pour structurer, nettoyer et exploiter les données efficacement.

Projets en TD

Réalisation de mini-projets en groupe pour appliquer les cours à des cas concrets : prévisions, clustering, visualisations dynamiques, etc.

Les cours et TD sont le cœur de ma formation en science des données. Chaque semaine, j’ai l’occasion de consolider mes acquis théoriques à travers des applications pratiques. Par exemple, en TD d’analyse exploratoire, nous avons travaillé sur des données issues de l’INSEE pour identifier des corrélations cachées entre indicateurs sociaux.

Ces séances permettent de mieux comprendre les enjeux des données dans des contextes variés. J’ai également beaucoup appris grâce à des challenges en groupe, où il fallait concevoir des tableaux de bord ou entraîner un modèle prédictif, tout en respectant des contraintes de temps et de qualité. Ces exercices m’ont appris la rigueur, la collaboration et la méthodologie agile.

Grâce à ces cours et TD, je me sens de plus en plus à l’aise avec des outils comme Python, Jupyter, ou des bibliothèques comme Scikit-learn. Ce sont des compétences que je continue à approfondir au fil des projets personnels ou professionnels.

Contactez-moi

- Email jk.klevine@gmail.com

- Téléphone +33 6 41 93 28 10

- LinkedIn Jude Klevine

Où me trouver

Luxembourg ville, Luxembourg